Les géants du numérique

THEME 2 : ANALYSER LES DYNAMIQUES DES PUISSANCES INTERNATIONALES

Axe 2: Formes indirectes de la puissance : une approche géopolitique

Jalon 2 : Les nouvelles technologies : puissance des géants du numérique, impuissances des Etats et des organisations internationales?

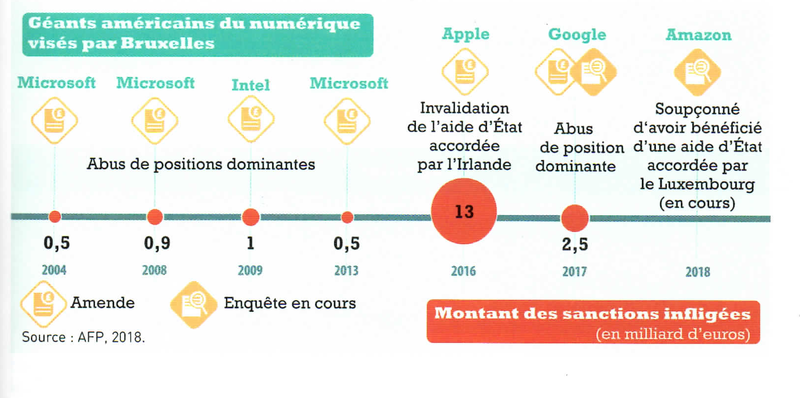

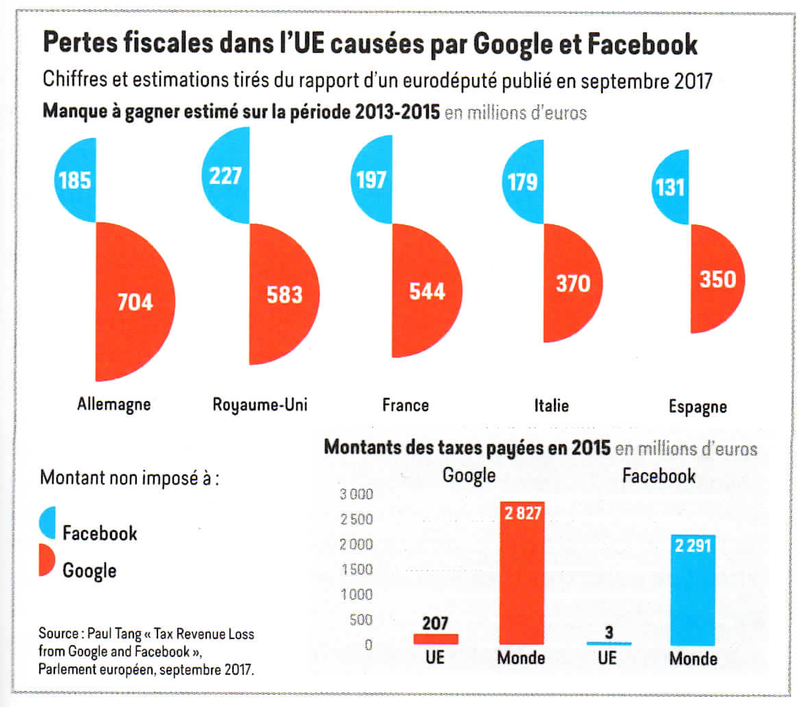

Bruxelles brandit la menace d’une taxe sur les revenus publicitaires des géants du numérique américains. Une mesure que l’Irlande, devenue un pivot fiscal des GAFAM en Europe, rejette.

Face aux géants du numérique, l’UE s’est dotée d’une législation ambitieuse, mais complexe dans son application. Plus largement, elle peine à s’imposer face aux plateformes.

ÉDITORIAL. En infligeant des sanctions financières contre Apple et Meta, accusés d’avoir enfreint le règlement sur les marchés numériques, la Commission européenne rappelle la nécessité d’encadrer les acteurs majeurs de l’Internet afin de limiter leur puissance, de plus en plus problématique.

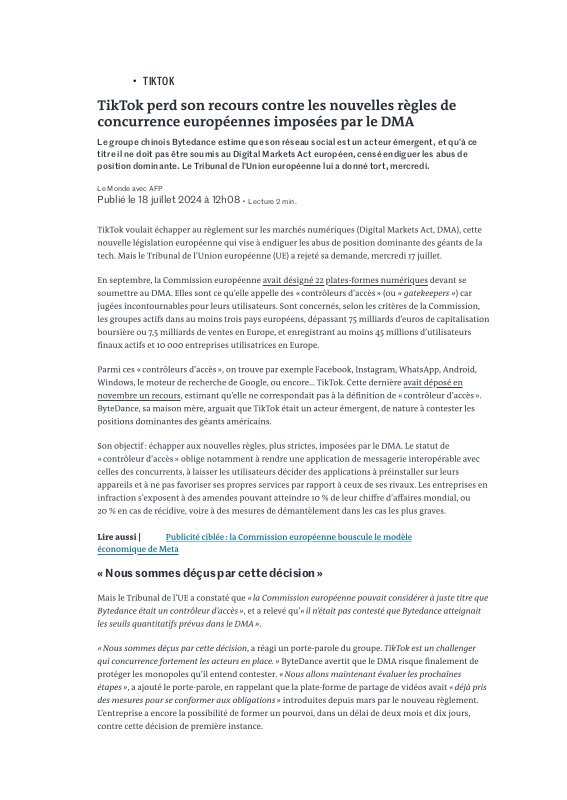

DMA : le règlement sur les marchés numériques veut mettre fin à la domination des géants du Net

Les géants du Net doivent depuis le 6 mars 2024 respecter de nouvelles obligations et interdictions, en vertu du règlement sur les marchés numériques (DMA), sous peine de lourdes amendes. L’Union européenne veut mettre fin à la domination de ces géants en leur imposant de nouvelles règles

La législation sur les marchés numériques (DMA) vise à lutter contre les pratiques anticoncurrentielles des géants d’internet et corriger les déséquilibres de leur domination sur le marché numérique européen.

Le modèle économique de ces acteurs, en particulier des Gafam (Google, Apple, Facebook, Amazon et Microsoft), repose sur la combinaison de masses de données sur leurs utilisateurs et d'algorithmes puissants et opaques. Grâce aux forts effets de réseau et à leurs écosystèmes enfermant les internautes-consommateurs, ces grands acteurs ont acquis une position de quasi-monopole sur le marché européen, laissant peu de place à la concurrence. (..)

Les entreprises désignées comme gatekeepers doivent nommer un ou plusieurs responsables de la conformité avec le règlement, sous peine d'amende, et doivent respecter une petite vingtaine d’obligations ou d'interdictions, pour chacun de leurs services de plateforme essentiels. Certaines sont applicables à tous, d'autres seront prononcées sur mesure.

Les contrôleurs d'accès doivent par exemple

- rendre aussi facile le désabonnement que l'abonnement à un service de plateforme essentiel ;

- permettre de désinstaller facilement sur son téléphone, son ordinateur ou sa tablette des applications préinstallées ;

- rendre interopérables les fonctionnalités de base de leurs services de messagerie instantanée (Whatsapp, Facebook Messenger…) avec leurs concurrents plus modestes ;

- autoriser les vendeurs à promouvoir leurs offres et à conclure des contrats avec leurs clients en dehors des plateformes ;

- donner aux vendeurs l'accès à leurs données de performance marketing ou publicitaire sur leur plateforme ;

- informer la Commission européenne des acquisitions et fusions qu'ils réalisent.

Les contrôleurs d'accès ne peuvent plus notamment :

- imposer les logiciels les plus importants (navigateur web, moteurs de recherche, assistants virtuels) par défaut à l'installation de leur système d'exploitation. Un écran multi-choix doit être proposé pour pouvoir opter pour un service concurrent ;

- favoriser leurs services et produits par rapport à ceux des vendeurs qui utilisent leur plateforme (auto-préférence) ou exploiter les données des vendeurs pour les concurrencer ;

- réutiliser les données personnelles d’un utilisateur à des fins de publicité ciblée, sans son consentement explicite ;

- imposer aux développeurs d'application certains services annexes (système de paiement par exemple).

Une personne lésée par un contrôleur d'accès pourra s'appuyer sur la liste de ces obligations et interdictions pour demander des dommages et intérêts devant les juges nationaux.

Cette liste pourra être complétée par la Commission, en fonction de l'évolution des pratiques des géants d'internet et des marchés numériques.

Quelles sanctions en cas de non-respect du DMA ?En cas d'infraction, la Commission européenne pourra prononcer contre le contrôleur d'accès une amende pouvant aller jusqu'à 10% de son chiffre d'affaires mondial total et, en cas de récidive, jusqu'à 20% de ce chiffre d'affaires. Elle pourra aussi prononcer des astreintes allant jusqu'à 5% de son chiffre d'affaires journalier mondial total.

Posted by

ngd

Posted by

ngd

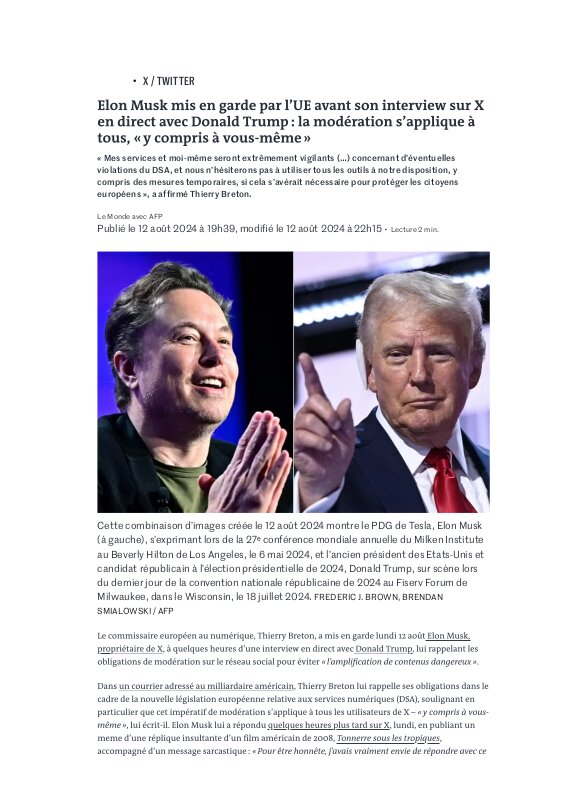

Elon Musk Mis En Garde Par L’Ue Avant Son Interview Sur X En Direct Avec Donald Trump La Modération S’Applique À Tous, « Y Compris À Vous Même »

Posted by

ngd

Posted by

ngd

« Le Combat De L’Ue Et Des Etats Unis Contre Les Géants Du Numérique Est Une Longue Marche »

Posted by

ngd

Posted by

ngd

Données Personnelles Linkedin Condamné À Une Amende De 310 Millions D’Euros Pour Ses Publicités Ciblées Dans L’Ue

Posted by

ngd

Posted by

ngd

Si l'activité des GAFA a transformé positivement la vie des Européens, elle doit aussi être régulée pour répondre aux nouveaux enjeux et éviter les abus : protection de la vie privée, protection des droits d’auteur, protection de la concurrence loyale... L'Union est mobilisée sur ces sujets !